Los robots que crean su propio lenguaje no conquistarán al mundo pronto

Walter Montes walter@enhancesol.com | Martes 08 agosto, 2017

Probablemente en los últimos días usted ha visto noticias (o encabezados de noticias) respecto a robots que "crearon su propio lenguaje". Muchos de ellos con tonos alarmistas e indicando que los científicos y técnicos "corrieron" a apagarlos.

Poco después, medios un poco más conscientes (o preparados) explicaban la razón por la cual estas noticias eran falsas (o alteradas) y que la gente no debía entrar pánico.

Al mismo tiempo, me han llegado personas a consultar al respecto para entender mejor, confirmar sus sospechas de que no es nada de que preocuparse o por miedo real por los noticieros.

Muchas de estas explicaciones que salieron en los últimos días son sumamente técnicas y por esto pensé necesario publicar, de manera más sucinta y simple, al respecto para personas técnicas y no técnicas.

Hace poco más de 1 año publiqué una nota hablando de algo similar de como la opinión popular podría potencialmente parar el desarrollo científico en ámbito de tecnología: El accidente del Tesla S y el miedo de la tecnología al rechazo público

Lo primero para dejar claro es que nadie entró en pánico en Facebook.

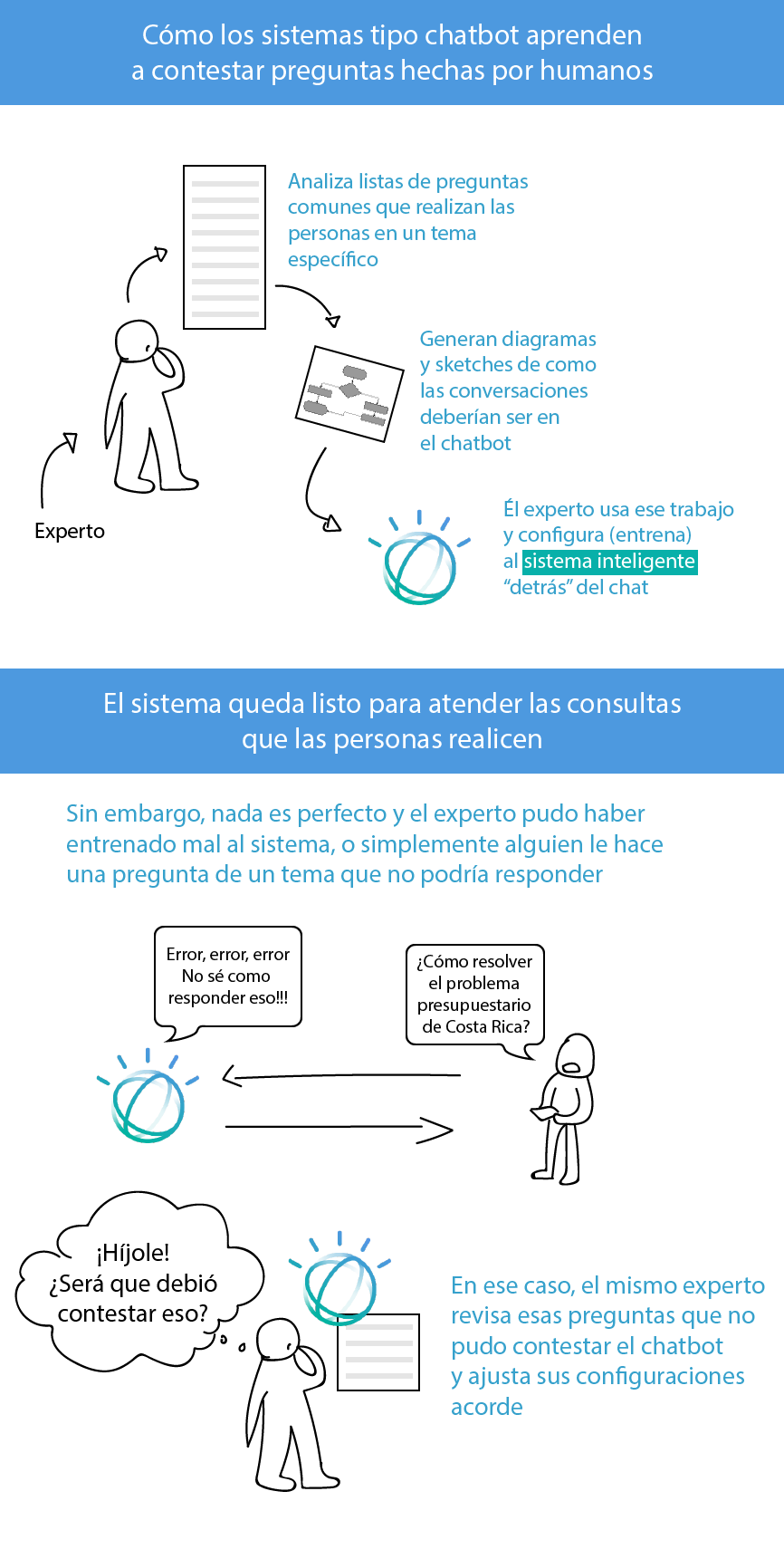

Lo segundo es comprender como funcionan los sistemas de inteligencia artificial que chatean con los seres humanos:

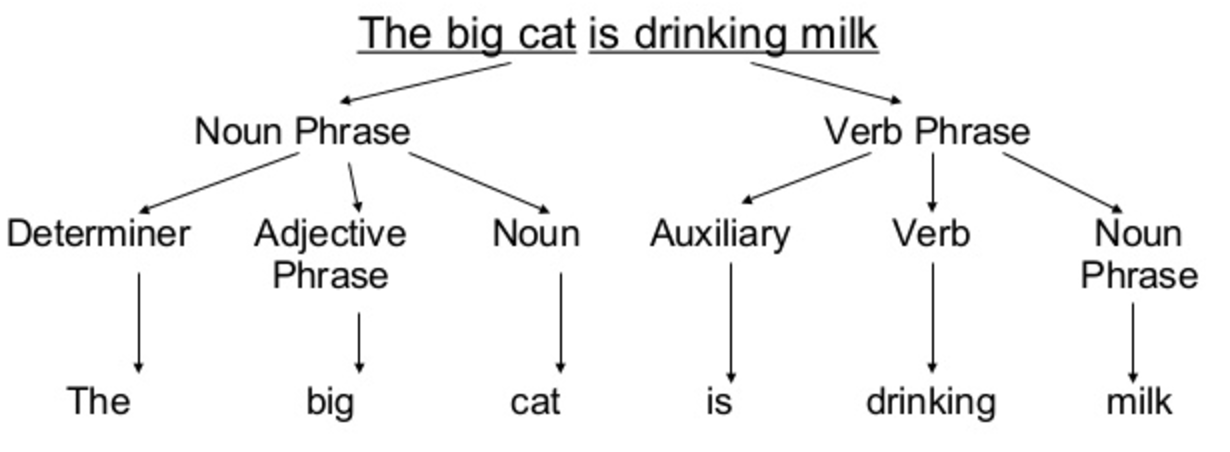

Al fin y al cabo, los sistemas inteligentes utilizan una ciencia llamada procesamiento de lenguaje natural y técnicas llamadas aprendizaje máquina (o machine learning), el cual "desmenuza" las oraciones según su contenido y traduce a un lenguaje más máquina (números), el cual es comparado contra lo que se entrenó antes al sistema y probabilísticamente indica si la pregunta se parece a algo que se le haya enseñado anteriormente (es decir, su conocimiento) y responde según el experto le haya enseñado al identificar ese "tema".

El proceso de entrenar un sistema de inteligencia artificial es constante y evoluciona con el tiempo, pero los sistemas usualmente no aprenden por si mismos, requieren un humano.

En el caso puntual de la noticia que referencio, los investigadores de FAIR (Facebook AI Research) querían crear un sistema que "negociara" con los humanos, entonces crearon un experimento en el cual ponían a dos chatbots a conversar entre sí para llegar al mejor acuerdo posible respecto al valor de algo.

A estos sistemas se les permitió "aprender" de cada interacción de tal forma que puedan ser más óptimos a la hora de negociar.

Ya que al final, en su procesamiento el lenguaje, el texto son solo un montón de números, durante las interacciones llegaron a la conclusión matemática que el mismo conjunto de palabras equivalen a una frase más humana y la "reemplazaron" en su negociación.

Por ejemplo:

La frase "quiero 3 bolas" equivale a "5"

Y también la frase "el el el" equivale a "5".

Por esto, empezaron a hablar más o menos así:

Bob: I can i i everything else

Alice: balls have zero to me to me to me to me to me to me to me to me to

Bob: you i everything else

Alice: balls have a ball to me to me to me to me to me to me to me to me

Y por ende "crearon su propio lenguaje" incomprensible por los humanos.

Para los fines del experimento, usar ese nuevo "lenguaje" no servía ya que el objetivo final era que negociara con humanos en lenguaje natural y debido a esto "apagaron" el experimento.

¡Así que por el momento no hay nada que temer! Por el contrario, la inteligencia artificial está ayudándonos a entender más información y respaldar nuestra toma de decisiones de manera más informada en múltiples industrias.

Nota: Los chatbots solamente conversaron de la negociación por los incentivos que se les dieron a la hora de configurarlos y nunca conversaron de conquistar el mundo